近日,机器学习领域国际顶级会议 ICML 2026(International Conference on Machine Learning) 录用结果公布,我院钱亚冠教授团队研究论文 《Toward Subspace-Perturbed Trajectory-Aware Backdoor Attacks in Deep Reinforcement Learning》 被正式接收。

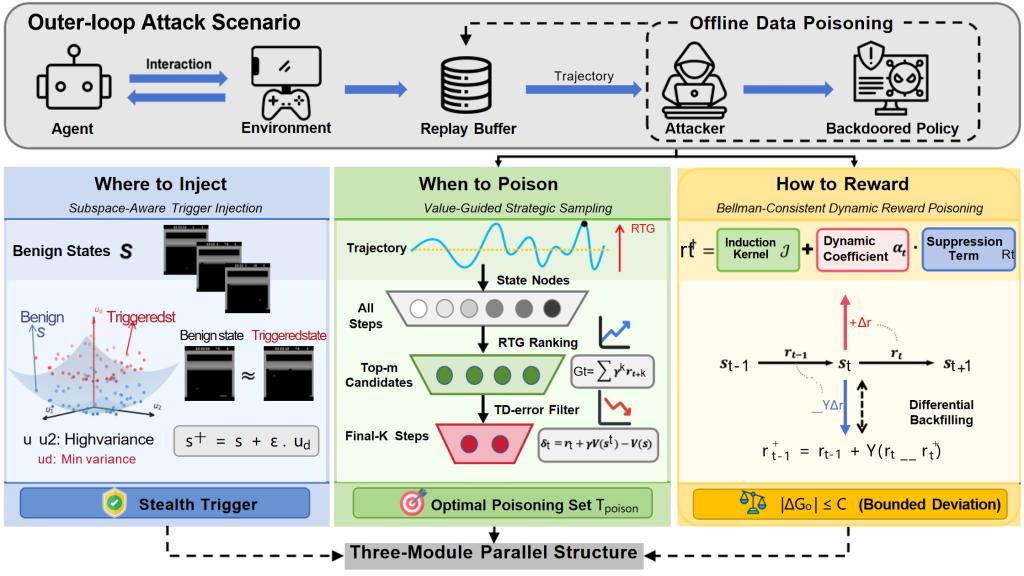

该研究面向深度强化学习安全问题中的后门攻击机理,针对感知隐蔽性、投毒效率与价值函数一致性之间的关键挑战,提出统一分析框架 SpecDRL。方法从状态子空间扰动注入、关键时间步选择与奖励一致性约束三个层面进行系统建模,为强化学习安全性分析提供了新的研究视角。论文正文加附录理论证明共计21页,充分展示了方法在理论上的严谨性。

ICML 是中国计算机学会(CCF)推荐的 A 类国际顶级会议,与 NeurIPS、ICLR 并称为机器学习领域国际三大顶会,竞争激烈、录用标准严格。本次论文录用体现了团队在人工智能安全与可信学习方向的持续研究积累与国际同行的学术认可。

钱亚冠教授团队长期围绕 AI模型安全、数据安全等方向开展系统研究。近五年,团队在 ICCV、ECCV、IEEE TIFS、TDSC、TKDE、TIP、TNNLS、TCSVT、ACM TOPS 及《软件学报》《计算机研究与发展》《电子学报》等国内外权威期刊和顶级会议发表论文30余篇,其中中科院一区TOP 6篇,CCF-A 类 9 篇;授权发明专利10余项。团队承担国家自然科学基金、中央军委科技委创新特区项目、浙江省自然科学基金重点项目等多项科研任务,并与海康威视等单位开展产学研合作。