近日,我院“人工智能与安全团队”在模型安全防御方面取得新的研究进展,相关成果《F2AT: Feature-Focusing Adversarial Training via Disentanglement of Natural and Perturbed Patterns》在线发表于国际顶级期刊《IEEE Transactions on Knowledge and Data Engineering》(TKDE)。作为中国计算机学会(CCF)与中国人工智能学会(CAAI)共同推荐的A类期刊,TKDE在人工智能与数据科学领域享有极高的学术声誉。此次成果发表系我校作为第一单位首次在该期刊发表研究论文。论文由我院钱亚冠教授、22 级研究生赵陈雨,及哈尔滨工业大学、浙江大学、西安交通大学、维多利亚大学等合作者共同完成。该项工作得到了国家重点研发计划项目、国家自然科学基金面上项目、浙江省自然科学基金重点项目等的资助。

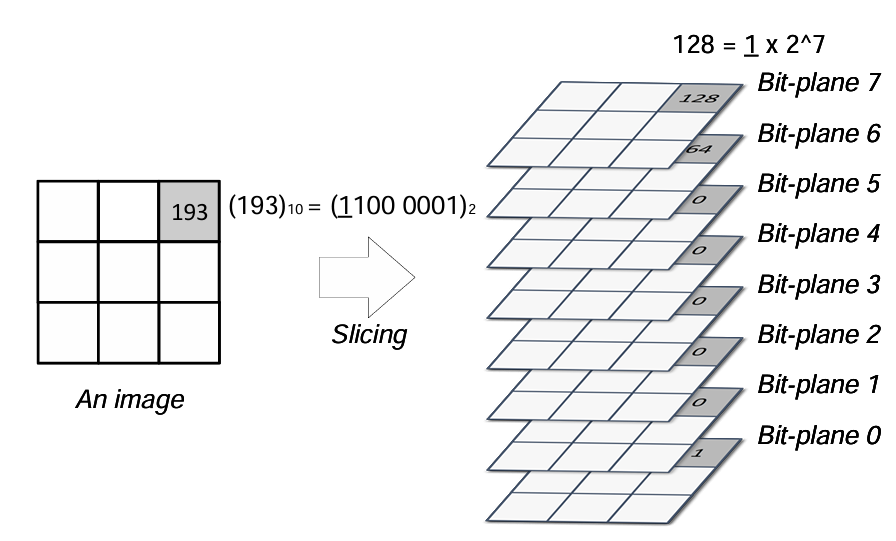

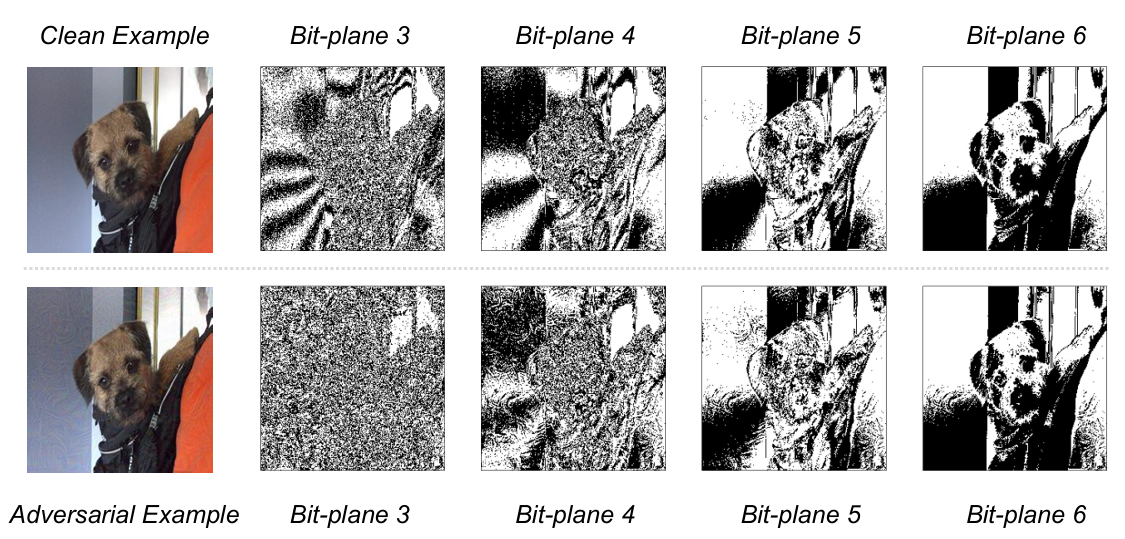

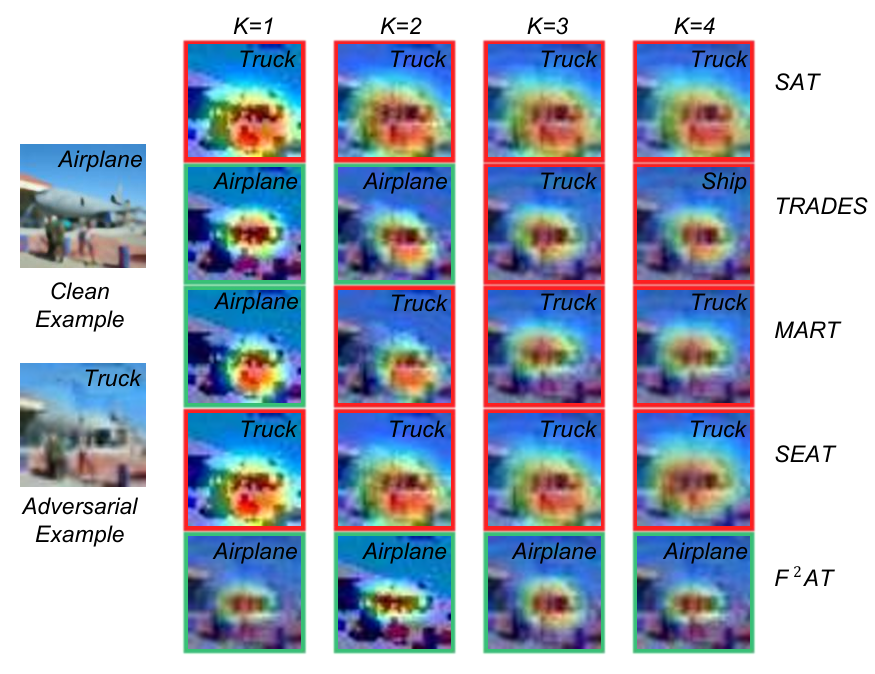

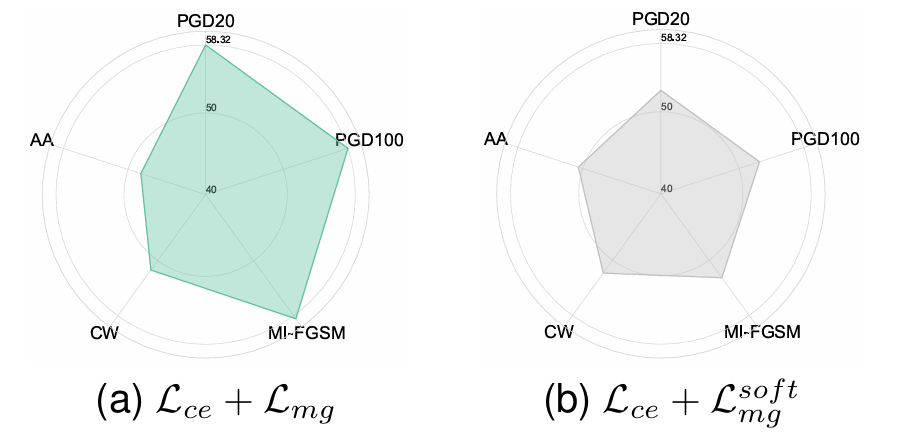

论文针对深度神经网络(DNN)容易受到由精心设计的扰动(对抗噪声)的影响,可能给自动驾驶、监控安全、医疗诊断等关键应用带来灾难性后果的挑战,提出一种新颖的对抗性训练防御方法。在传统的对抗训练中,DNN仍然会学习到虚假特征,难以在准确性和鲁棒性之间取得良好的平衡。其内在原因是传统的对抗训练无法很好地分离噪声和良性样本,因此难以从对抗性样本中充分学习到核心特征。论文假设较高的位平面代表自然模式,较低的位平面代表扰动模式,通过位平面切片的思路,将对抗样本分解为自然模式和扰动模式,从而有效地分离噪声和干净样本。进而提出了特征聚焦的对抗性训练(F2AT)思路,强制模型关注自然模式中的核心特征,并减少来自扰动模式的虚假特征的影响。论文通过严格的理论证明和全面的实验评估,表明该方法可以显著提高识别的准确率和对抗鲁棒性。